带你亲身体验 GPT,训练你的聊天机器人!

1、GPT入门指南

最近,大家对于人工智能聊天机器人 GPT 的兴趣日益高涨。你也想尝试一下吗?想知道自己的小模型和大模型之间的差距?还想让你的小模型具备逻辑推理能力或特殊定制的应用价值?不用担心,在这里为你提供一个个人电脑上训练 GPT 的简单方法!

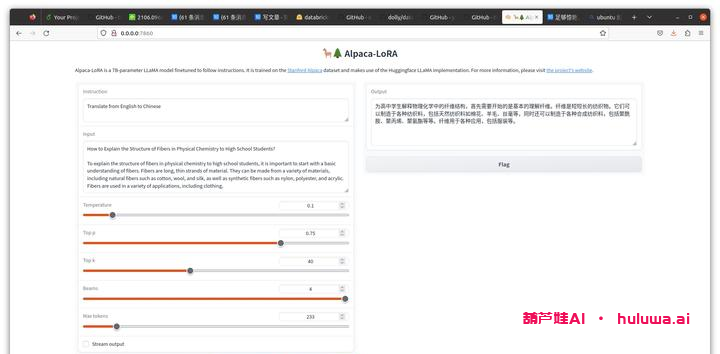

首先,你可以从网上下载一个名为 Alpaca-Lora 的 GPT 开源项目。虽然在国内下载预训练权重可能会遇到一些曲折的过程,但只要按照我们提供的步骤,你就能成功运行它。最新版本的 Alpaca-Lora 在 alpaca_data_gpt4.json 数据上进行了训练,并且默认情况下表现不错。

想要让 GPT 进行中文问答,我们可以尝试以下方法:将中文问题翻译为英文,用英文回答,再将回答翻译回中文。这样的方法能够更加精确地回答问题。当然,如果你想在微调后提高 GPT 的能力,可能需要调整学习率、增加 Epoch 数量或者增大词表等。另外,使用好的 Reward 模型,并借鉴 GPT 使用的 PPO 强化学习训练方法,也能够有效地提升 GPT 的能力,特别是推理能力。

如果你顺利安装并成功下载 Alpaca-Lora 的基础模型参数和微调参数,就可以用一个简单的命令创建一个本地的 web 服务,然后在浏览器中输入对应的网址,就能开始体验 GPT 啦!

2、GPT的应用场景

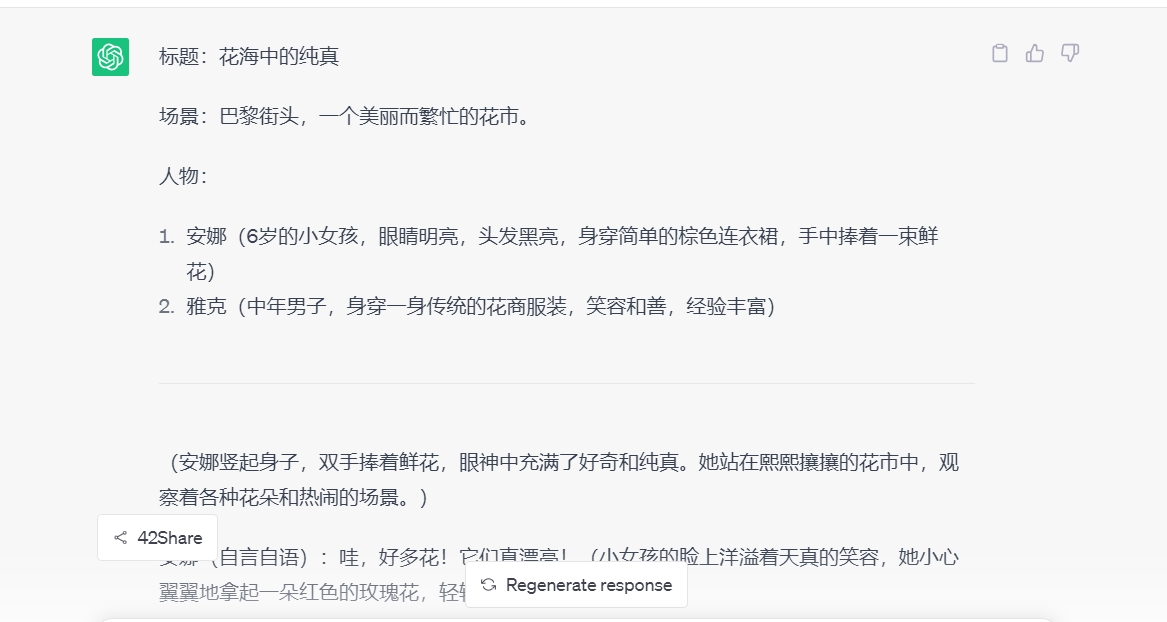

GPT 不仅可以用于问答,还可以用于其他各种场景。例如,你可以用 GPT 进行物理学的解释,将复杂的概念用简单易懂的语言向高中生解释。你还可以用 GPT 进行翻译,将输入的内容翻译为不同的语言。此外,GPT 还可以帮助我们思考如何减少空气污染,提供解决方案和建议。

3、GPT的训练和使用

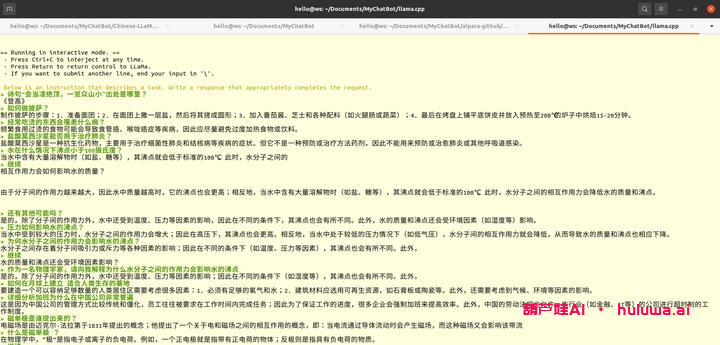

想要进一步提升 GPT 的中文理解能力?你可以尝试使用开源的 Chinese-LLAMA-Alpaca 13B 模型。它在中文语料上的表现更加出色。只需使用中文语料对其进行微调,就能获得更好的效果。

在训练过程中,你可能需要花费一些时间和计算资源。对于 RTX4090,训练 3 个 Epoch 大约需要 5 个小时。此外,微调过程中可能会占用一定的显存资源。

在安装和下载 Alpaca-Lora 时,可能会遇到一些问题。如果你遇到困难,可以参考一些开发者的经验,避免踩坑。最重要的是保持耐心,按照指引一步步操作,相信你一定能够成功!

总览

快来亲身体验 GPT 吧!通过简单的步骤,你就能在个人电脑上训练自己的聊天机器人。不仅可以进行问答,还可以应用到各种场景中。想要进一步优化 GPT 的中文能力,可以尝试使用开源的 Chinese-LLAMA-Alpaca 13B 模型。遇到问题时,记得保持耐心,并参考开发者的经验。快来开启 GPT 的奇妙之旅吧!

感谢您的阅读!

暂无评论内容