摘要: Openai的Chatgpt和Microsoft的Copilot等生成的AI工具正在成为日常商业生活的一部分。但是他们带有您应该知道的隐私和安全考虑。

AI技术引发隐私与安全担忧

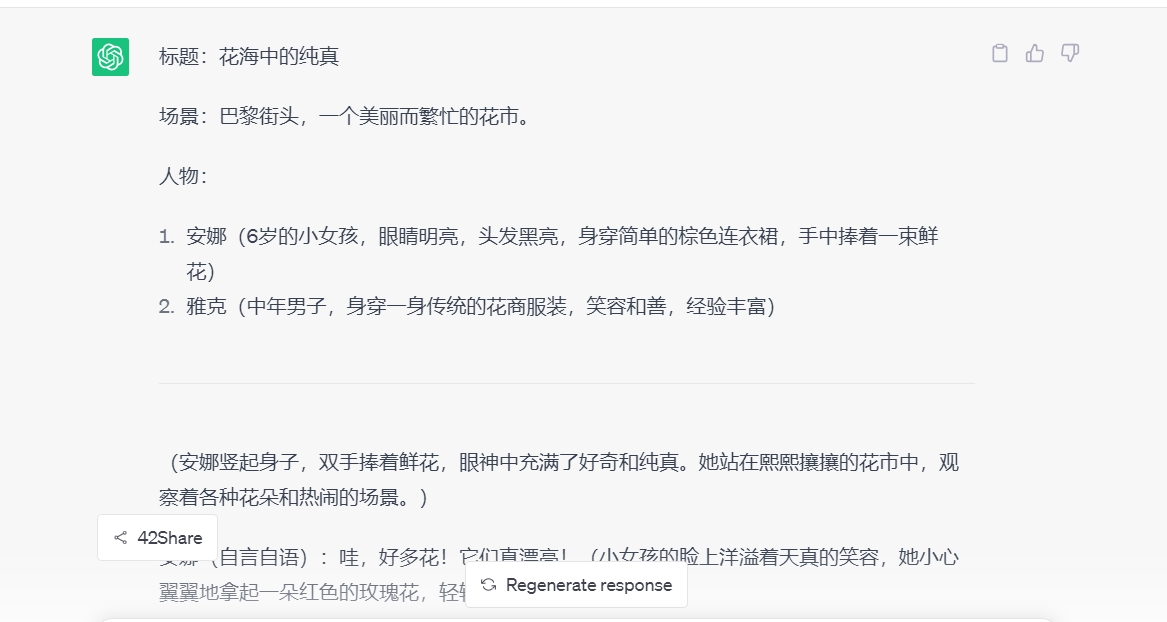

生成式AI工具,如OpenAI的CHAT GPT和Microsoft的Copilot,正在快速发展,引发人们对技术在工作场所可能带来的多重隐私和安全问题的担忧。

今年五月,隐私活动人士称Microsoft的新Recall工具可能是一个“隐私噩梦”,因为它能够每隔几秒就截取您笔记本电脑的屏幕截图。这一功能引起了英国监管机构信息专员办公室的关注,该机构要求Microsoft透露更多关于即将在其Copilot+ PC上推出的产品安全性的信息。

人们也对OpenAI的CHAT GPT表示担忧,该技术在即将推出的macOS应用中展示了截屏功能,隐私专家表示可能会导致敏感数据被获取。

美国众议院已禁止工作人员使用Microsoft的Copilot,因为网络安全办公室认为这可能会给用户带来风险,存在“泄露众议院数据给未经众议院批准的云服务”的威胁。

与此同时,市场分析公司Gartner警告称,“在Microsoft 365中使用Copilot会暴露内部和外部的敏感数据和内容风险。”上个月,谷歌在其新的搜索功能AI Overviews上做出调整,因为对查询结果的奇怪和误导性答案的截图在网络上疯传。

过度暴露

对于在工作中使用生成式AI的人来说,最大的挑战之一是意外暴露敏感数据的风险。风险管理公司GRC International Group的AI集团负责人Camden Woollven表示,大多数生成式AI系统“本质上就是大海绵”,它们从互联网上吸收大量信息来训练语言模型。

AI公司“渴望获取数据来训练他们的模型”,软件公司Elementsuite的首席执行官Steve Elcock表示,这种大量数据收集意味着敏感信息有可能被“放入其他人的生态系统”,数字咨询公司xDesign的首席产品和技术官Jeff Watkins表示,“通过巧妙的引导,这些信息也可能被提取出来。”

同时,AI系统本身也面临被黑客攻击的威胁。风险管理公司Prism Infosec的首席顾问Phil Robinson表示,使用“专有”AI工具也可能存在问题,这些工具被广泛认为在工作中是安全的,比如Microsoft Copilot。

另一个问题集中在可能被用于监控员工的AI工具上,潜在侵犯员工隐私。Microsoft的Recall功能表示,“您的快照属于您;它们始终保留在您的PC上”,“您始终可以信任隐私保护。”

暂无评论内容